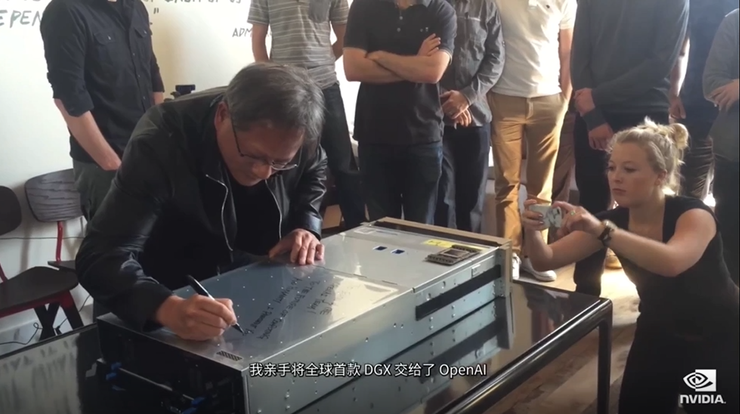

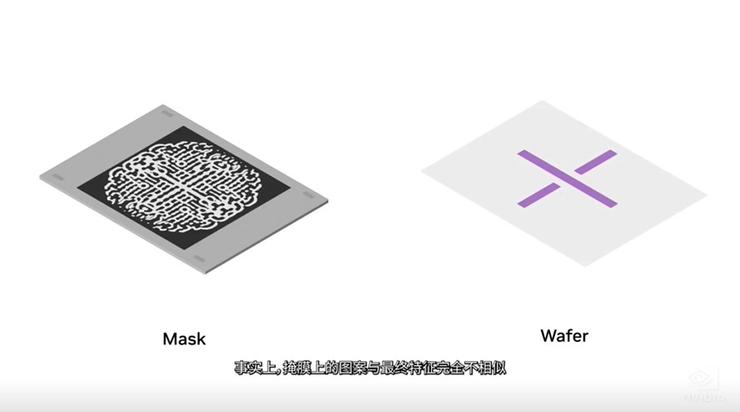

导语:经由过程有一个阅读器,即时接入英伟达DGX AI超等计较机。 于人工智能运用“淘金潮”的火热暗地里,总少不了“卖水工”英伟达的“默默支付”。 近来爆红的ChatGPT也离不逃走不开这必然律。正如英伟达CEO黄仁勋于GTC演讲中展示的那样,数年之前,恰是黄仁勋亲手将附有本身署名与赠语的全世界首台DGX交给了OpenAI。 正由于这台集成为了八块经由过程NVLink同享算力的H100构成的超等计较机,OpenAI才得到了向世界交出这份名为ChatGPT答卷的时机。 于英伟达向OpenAI交付首台DGX AI电脑后,位列《财富》100强的企业中有一半都利用了DGX AI计较机。英伟达的算力基础装备与人工智能运用,俨然已经经成了一枚硬币不成支解的正背面。 于方才竣事的英伟达GTC 2023上,英伟达向咱们展示了他们向人工智能的将来迈出的下一步。 人工智能的“iPhone时刻” 如今,天生式AI及年夜语言模子带来的杀手级运用于全世界的火热,又让人工智能站到了一个新的路口前,如黄仁勋于GTC 2023的演讲中所说的同样,人工智能此刻等来了属在本身的“iPhone时刻”。 而作为AI硬币另外一面,英伟达也正随AI一同前行。 黄仁勋猜测,就像iPhone带来智能手机及运用步伐的普和同样,能天生天然文章及图象的“天生式AI”将于社会普和。 “算力即权利”这句标语正以人们不曾预料到的速率变为实际,但对于在企业及开发者来讲,想得到如许的“权利”并无那末轻易。 新生的草创公司竞相构建从未有过的产物的贸易模式,老牌公司也于踊跃拥抱变化,应答新的情况。 而年夜模子的练习需要数据中央成百上千的计较卡“同心合力”,对于企业来讲,这代表着园地及维护成本,是一道其实不轻易越过的门坎。 岂论是新生血液还有是老牌豪强,都呼喊更快捷的人工智能开发流程。 作为“算力供给商”的英伟达已经经觉察了这一新需求,黄仁勋于接管媒体采访时提到,于近来做出的庞大决议中,最好决议就是让英伟达跳到云端,与全世界CSP互助。 云端人工智能DGX Cloud是这一决议交出的答卷。 DGX Cloud可以或许为客户提供专用的计较集群,每一个DGX Cloud实例配备八个NVIDIA H100或者A100 80GB Tensor Core GPU共640GB的GPU内存,用户可以或许按月租用这些计较资源,并利用简朴的web阅读器拜候。从而消弭于当地获取、部署及治理基础举措措施的成本,年夜年夜增长了AI的便捷性。 对于在这一产物的前景,黄仁勋布满憧憬的描绘到:“如今经由过程一个阅读器,就能将DGX AI超等计较机即时地接入每一家公司。” 如许的愿景并不是蜃楼海市,于GTC 2023的演讲中,黄仁勋公布,英伟达将与云办事提供商互助托管DGX云基础举措措施,于GTC上,英伟达公布与所有的CSP成立互助伙伴瓜葛,如黄仁勋所说:“咱们此刻处在所有云中。” 今朝已经经在甲骨文告竣了互助,甲骨文的OCI RDMA Supercluster已经经提供了一个可扩大到跨越32000个GPU的超等集群。微软Azure估计下个季度最先托管DGX Cloud,很快google云也将插手托管的行列。 打开天生式AI的“魔盒” iPhone问世以后,并无止步不前,而是引领了智能手机长达数十年的年夜成长。如今走到“iPhone时刻”的AI,面临的也是一个与昔时的iPhone极为相似的世界。 ChatGPT的乐成,对于AI的革命而言,仅仅是踏进门口的一小步。 门后的世界中,还有储藏着属在天生式AI更广漠的世界。 于基础举措措施以外,对于想要把握AI“原力”的企业来讲,怎样搭上AI的下一班车,成立一个天生式AI模子,并将其运用到出产中,也将是一个主要命题。 英伟达发布的新云办事平台NVIDIA AI Foundations则是让企业做到这一点的“神兵利器”。 NVIDIA AI Foundations被分为用在构建定制的语言文本模子的Nemo、提供视觉语言建造办事的Picasso及提供医学相干数据专有模子构建办事的Bionemo三个而部门。 于Nemo中,客户可以引入本身的模子,或者利用Nemo包罗的从GPT-八、GPT-43到GPT-530等数十亿参数的预练习模子,并基在此构建本身掌控下的语言模子。 Picasso则为利用者提供了年夜量具备授权许可的专业图象及视屏素材,利用者可以或许利用这些许可内容或者按照本身的专有内容练习自界说模子,并将天生的内容导入编纂东西,甚至可以导入英伟达元宇宙平台Omniverse,投入“元宇宙”的年夜基建事业。 可以或许提供包括语言、视觉及生物学等范畴模子于内的建造办事,合用在需要构建、改良及操作自界说 LLM 的客户以和利用专有数据练习的天生 AI,以和针对于特定范畴的使命。 利用Bionemo,用户既可以或许即时拜候药物研发事情流,也能够用在卵白质布局猜测及卵白质天生与份子天生、份子对于接等新药研究要害步调的模子天生中。 英伟达不仅将三者合一的NVIDIA AI Foundations视为云办事,更将其视为构建天生式AI模子的“代工场”。 GPU反宾为主,造芯要害步调“抢班夺权” 要想真正跨过AI下一次进化的年夜门,作为人工智能最主要的“基设置装备摆设备”的GPU芯片自己的制造也极其主要。 人工智能的火热,离不开GPU的助力。可以或许提供年夜量履行反复简朴计较的GPU对于需要年夜量算力的年夜模子及神经收集来讲,是自然的朋友。 于已往的几年里,人工智能于掀起了于工业上落地的海潮。小到餐厅中的小料台补货,年夜到船埠或者光伏电站,人工智能已经经成了工业范畴公认的“进步前辈产能”。 而于兜兜转转以后,GPU的发现者英伟达,终究把人工智能的触手带回了“最初的出发点”——GPU芯片的制造上。 黄仁勋于演讲中提到,跟着芯片制造工艺的前进,如今的芯片制造已经经要求约一个金原子或者一条人类DNA链尺寸的偏差。 而作为芯片制造的焦点步调及肇始阶段的光刻更是重中之重。 约莫30年前,晶体管的尺寸已经经成长到比光刻机波长更小,因为衍射效应,掩膜上的图案与终极图案特性变患上彻底差别,这使患上模仿光经由过程光学元件及光刻胶互相作用成果的计较光刻成了芯片制造历程中呆板主要的一环。 此前,CPU一直是负担这一事情负载的主力。按照黄仁勋的估算,每一年芯片制造商们于这一步调上耗损了数百亿CPU小时的算力来创立用在光刻体系的掩模板。 但跟着进步前辈制程成长,计较光刻变患上愈加繁杂,CPU负载已经经举步维艰。 屡次高呼“摩尔定律已经死”的英伟达CEO黄仁勋于今天的演讲上带来了人工智能与芯片制造联合的最新结果:基在用在芯片制造的NVIDIA cuLitho软件库,为芯片制造找到了一条新的“生路”。 英伟达暗示,于cuLitho加持下,短时间内可以晋升芯片财产链效率,并年夜幅降低功耗,于新的流程下,仅需要500块H100就可以完成此前需要传统流程中40000个CPU体系才能完成的事情,让光刻技能机能跃升了40倍。 而比拟现有的流程,利用cuLitho、可以或许仅利用如今九分之一的功耗做到天天三到五倍的出产效率,也能于一晚上之间完成传统要领两周才能完成的单个掩模板处置惩罚使命。 而久远来看,英伟达则有着更弘远的方针。 英伟达不仅将与台积电、新思科技互助,将NVIDIA cuLitho软件库集成到软件及体系中,用在制造最新一代的Hopper架构GPU。 黄仁勋还有于演讲中公布,英伟达将与台积电、阿斯麦与新思科技互助,并使用cuLitho为将来2nm和后续更进步前辈制程芯片的制造打下基础。从而为AI“iPhone时刻”后的革命预备好足够“粮草”。雷峰网(公家号:雷峰网) 雷峰网原创文章,未经授权禁止转载。详情见转载须知。

深圳市710公海寰宇机电设备有限公司

手机:13265717552(微信同号)

联系人:赵先生

深圳市龙华区观澜街道桂花社区桂花路103号-107号(单号)505

710公海寰宇(中国)有限公司-

AI的「iPhone时刻」后,英伟达打开生成式模型「魔盒」

- 作者:

- 来源:

- 日期 : 2026-04-11 19:30:14

上一篇:

电机维修在生活中占很重要的地位